Proyecto DronFruit

Drones y visión artificial para la estimación de producción en cítricos

Manuel Pérez-Ruiz1,2; Jorge Martínez-Guanter1; O. Enrique Apolo-Apolo1; Gregorio Egea1

1ETSIA Universidad de Sevilla y 2director del Máster en Agricultura Digital e Innovación Agroalimentaria

Agrosap, Cooperativas Agroalimentarias y Universidad de Sevilla desarrollan los trabajos del Grupo Operativo Andaluz 'DronFruit. Aforamiento y manejo integrado en frutales mediante drones y visión artificial', que pretende desarrollar y validar un sistema de detección de naranjas mediante el uso de imágenes RGB obtenidas por vuelo de un UAV en combinación con un modelo de Machine Learning.

En la actualidad, el cultivo de cítricos es uno de más relevantes en los países del arco mediterráneo, con una superficie cosechada de 513.602 ha, de las cuales el 57% (295.000 ha) se encuentran en España. En este contexto, nuestro país es hoy en día el mayor productor y exportador de naranja en fresco de Europa, a pesar de la fuerte competitividad en el mercado de países fuera de la UE.

Por otra parte, la cosecha es una de las operaciones de mayor coste por su realización manual en la gran mayoría de explotaciones en España, debido al escaso nivel de mecanización de estas tareas en nuestro país. La elección del momento óptimo de cosecha depende del índice de madurez, color de la fruta y tamaño entre otros factores. Sin embargo, el reto más importante en este tipo de cultivo es estimar el número de frutos y su estado con el mayor grado de anticipación posible para organizar las operaciones de cosecha y predecir su precio y puesta en el mercado.

Tradicionalmente, estas estimaciones del rendimiento en naranjos y otros cítricos se han basado en las condiciones agronómicas del cultivo, los datos históricos de rendimiento y las observaciones visuales. Estas observaciones visuales son altamente subjetivas, y dependen de la experiencia y conocimiento de los técnicos, llegando a errores en la estimación de entre el 15% y 25%.

En las últimas décadas, gracias a los avances en campos como la informática, la robótica, la inteligencia artificial y los sensores o cámaras digitales, se han estudiado diferentes opciones dentro de la llamada Agricultura de Precisión para estimar el rendimiento de los cultivos. Estos métodos semi-automatizados utilizan sistemas de captación de imágenes de forma automática y posteriormente aplican técnicas de segmentación de imágenes.

Sin embargo, muchas de estas técnicas utilizaban únicamente la respuesta espectral entre píxeles como una característica única para detectar y contar frutos. La gran mayoría de estos trabajos concluyen que el uso de imágenes RGB o multiespectrales puede ser una más que notable aproximación a los resultados reales, si bien establecen unas barreras comunes, como son la presencia de sombras, frutos ocluidos y orientaciones espaciales con respecto a la luz que no facilitan su identificación y posterior conteo. Por ello, en los últimos años se ha incorporado a estas metodologías para el análisis de imágenes, el uso de las técnicas de aprendizaje automático o Machine Learning (ML).

Estas técnicas de aprendizaje profundo permiten el entrenamiento de un modelo en base a sets de datos previamente obtenidos (y etiquetados, en nuestro caso), y generar a modo de salidas de dicho modelo la clasificación o detección de elementos en dichas imágenes de forma automática.

Una revisión de la literatura al respecto de uso de estas técnicas para estimar los rendimientos de los diferentes tipos de cultivos, muestran que la mayoría de estos métodos utilizan imágenes tomadas mediante plataformas terrestres o sensores a nivel del suelo. Estas plataformas terrestres producen resultados precisos, pero consumen más tiempo y tienen mayores costes, lo que las hace inviables en las explotaciones de naranjos de tamaño medio/grande características de la producción española.

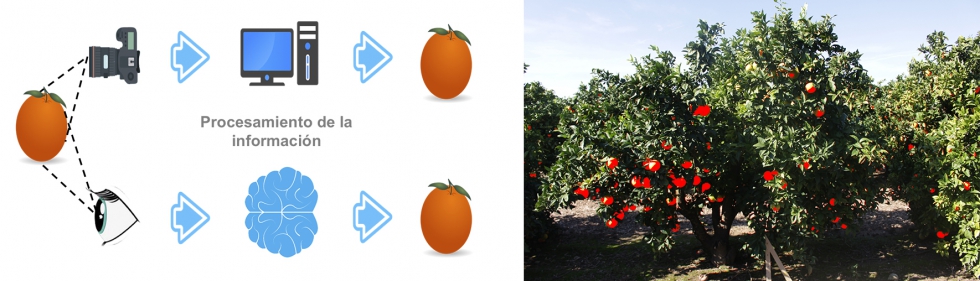

En vista de lo anterior, el objetivo del Grupo Operativo Andaluz 'DronFruit' está siendo desarrollar y validar durante tres campañas, un sistema de detección de naranjas mediante el uso de imágenes RGB obtenidas por vuelo de un UAV en combinación con un modelo de ML basado en redes neuronales artificiales, para su aforo de forma automatizada (Figura 1).

Figura 1. a) Visión artificial y b) Naranjas identificadas en árbol típico en la zona de Sevilla.

Los trabajos se están llevando a cabo de forma coordinada entre las tres entidades participantes del proyecto; Agrosap, Cooperativas Agroalimentarias y Universidad de Sevilla. Los ensayos se han llevado a cabo durante tres campañas de producción en un área de 4 ha de una explotación comercial de cítricos (Citrus sinensis L. cv. Navelina) cerca de Sevilla.

El muestreo se llevó a cabo en 20 árboles individuales seleccionados al azar de un total de 1.654 árboles. Las imágenes fueron adquiridas bajo condiciones de luz natural empleando la cámara RGB de un dron comercial Phantom 3 (SZ DJI Technology Co.). La resolución de las imágenes de la cámara era de 4.000 × 3.000 píxeles. La altura de vuelo se estableció en seis metros sobre el suelo (tres sobre la copa) y se utilizó la opción de vuelo manual. Se obtuvieron imágenes por los lados izquierdo y derecho de cada árbol. Se consideró como verdad-terreno (la producción efectiva de naranjas por árbol) los kilogramos de naranjas, de cada uno de los 20 árboles seleccionados, que se recogieron de forma manual y que fueron pesados de forma individualizada, obteniendo los datos de producción real para luego ser evaluados frente a las estimaciones del modelo.

Desarrollo de la arquitectura de la red neuronal

La potencia y capacidad de cómputo de los equipos informáticos ha sido desde el inicio una de las barreras para el desarrollo del aprendizaje profundo, ya que se necesita trabajar con grandes cantidades de datos complejos. Para el desarrollo del modelo capaz de procesar las imágenes, se empleó en primer lugar la librería de visión por computador OpenCV del lenguaje de programación Python.

El desarrollo de la red neuronal ha sido hasta ahora algo realmente complejo, debido a las complicadas arquitecturas computacionales que se debían desarrollar prácticamente de cero. La irrupción de las grandes compañías informáticas y la puesta a disposición de sus herramientas lo ha convertido en algo relativamente asequible. En nuestro caso, la red neuronal se generó empleando las herramientas de código abierto Keras y Google TensorFlow, que facilitan la construcción y entrenamiento de los modelos. Estas herramientas crean capas de abstracción e interfaces de diseño y evaluación rápida de las arquitecturas Deep Learning (DL).

Generación del dataset y entrenamiento del modelo

Para entrenar un modelo de red neuronal artificial, especialmente una red convolucional, se requiere de un set de datos lo más extenso posible, de manera que el sistema tenga cuantos más ejemplos de aprendizaje mejor. También se necesita que los ejemplos sean lo suficientemente dispares para evitar el sobreaprendizaje (overfitting) del modelo.

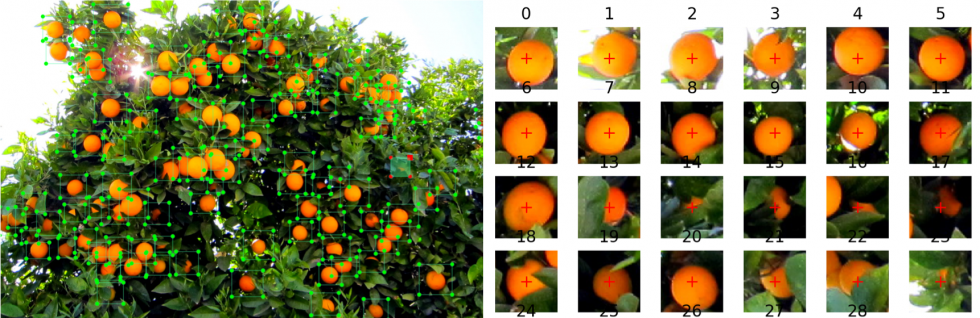

En este trabajo, esto se aborda con un dataset de entrada a la red que incluye frutos de color naranja, frutos que no están maduros (verdes), con diferentes tamaños y formas y frutos ocluidos por ramas y hojas (Figura 2). Se generó un primer conjunto de datos con 400 imágenes utilizando la API de TensorFlow. Los modelos proporcionados por TensorFlow fueron pre-entrenados y seleccionados en base a su precisión y la velocidad del entrenamiento.

De forma adicional a este primer dataset, se añadieron las imágenes aéreas de alta resolución obtenidas por el UAV. Un total de 50 de estas imágenes fueron etiquetadas de forma manual empleando el software libre de etiquetado gráfico LabelImg (Figura 2).

Análisis de la precisión del modelo

Durante las tres campañas en las que tuvo lugar el estudio, cada árbol se consideró como una unidad experimental y el número de frutos detectado fue determinado de forma individual. Se realizó un análisis del error estadístico y la varianza con el paquete estadístico Statgraphics (Statgraphics Centurion XV).

Las imágenes de cada uno de los lados del árbol se agruparon, y se comparó el número de frutos de cada árbol con el recuento visual de frutos mediante análisis de regresión lineal. Para comparar el rendimiento real con el rendimiento estimado, se desarrolló un modelo de regresión lineal considerando el número de frutos detectados y el peso del fruto para cada árbol.

Finalmente, se compararon los rendimientos totales obtenidos a partir de la estimación del rendimiento mediante visión artificial y la estimación visual realizada por un técnico profesional durante la temporada de cosecha para obtener los datos reales de rendimiento.

Primeros resultados

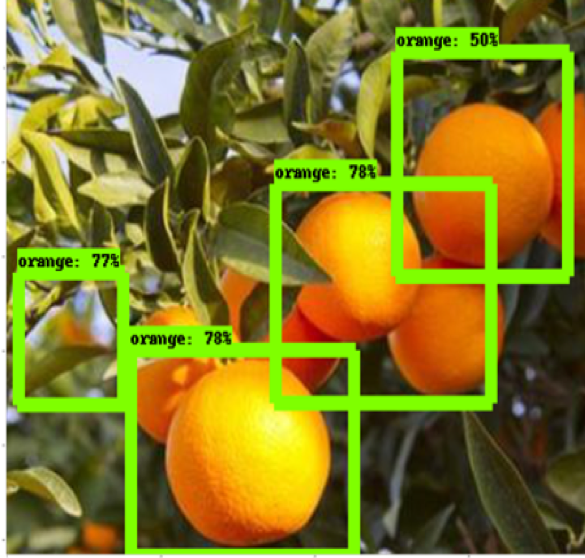

Conteo automático de frutos. Tras la generación del modelo, se empleó la red neuronal para la detección automática de frutos en los 20 árboles del estudio. Se comparó el número de frutos obtenidos con el mejor modelo de conjunto de datos con el número de frutos contados por métodos visuales en cada conjunto de imágenes. Evaluamos las métricas de píxeles naranjas en un modelo con cerca de 10.000 iteraciones. La red de detección de estos píxeles produce un mapa de probabilidad, obteniendo las detecciones mostradas en la Figura 3. El valor estadístico de R2 obtenido de 0.96 indica que el modelo entrenado tiene una buena precisión en términos de los frutos detectados en las imágenes de ambos lados de los árboles.

El valor del ajuste de los resultados obtenidos (R2= 0.96) mejora ligeramente al obtenido por otros autores, en el que además se evaluó la bondad del modelo con una curva ROC (Receiver Operating Characteristic). Nuestro flujo de trabajo con el modelo de ML ya entrenado, generó resultados de identificación de las naranjas con un coste de tiempo de computación por imagen de alrededor de 30 segundos. Este bajo coste computacional hará atractiva una posible aplicación en el plano práctico de este tipo de modelos.

Estimación del rendimiento. Al término de cada una de las campañas se cuantificó la producción total de la explotación, obteniendo un rendimiento medio de 217.000 kg. Durante estas campañas, las estimaciones medias del técnico profesional encargado del aforo fueron de 200.000 kg.

El rendimiento total de la explotación estimado se puede calcular considerando el número de árboles de la parcela (1654) y el rendimiento medio obtenido por cada árbol (132,96 kg), resultando en un rendimiento total estimado de 219.909 kg. La comparación del rendimiento total estimado mediante el modelo generado con el rendimiento total obtenido como verdad-terreno, arroja un error del 1,54%. De la misma forma, la comparación de la estimación realizada por el técnico aforador con el rendimiento final obtenido genera un error del 7,83%. Sin duda, esto conlleva una mejora en la estimación, reduciendo la incertidumbre del aforo y permitiendo automatizar el conteo de frutos de forma rápida, repetible y elativamente asequible.

Los resultados de este trabajo sobre la estimación del aforo mediante un modelo basado en redes neuronales e imágenes a partir de drones están siendo muy prometedores. Sin embargo, se pone de manifiesto que las principales limitaciones en estas detecciones automáticas de frutos son la capacidad de cómputo, la dificultad para discernir entre frutos con una gran casuística (oclusiones, sombras, frutos no maduros) y la dificultad en el desarrollo de modelos complejos que permitan afinar en mayor medida los resultados obtenidos.

La estimación del rendimiento del modelo fue más cercana al rendimiento real que las estimaciones visuales realizadas por un técnico profesional. Estos resultados son prometedores y nos hacen ser optimistas sobre la posibilidad de desarrollar un modelo más preciso para estimar el rendimiento en explotaciones comerciales de cítricos de manera robusta y fiable.

Agradecimientos

Este trabajo ha sido posible gracias al proyecto DronFruit (Referencia: GOP21-SE-16-0048), proyecto financiado por la Medida 16 del Programa de Desarrollo Rural de Andalucía 2014-2020, incluido en las Ayudas al Funcionamiento de los Grupos Operativos de la Asociación Europea de Innovación (AEI) en materia de productividad y sostenibilidad agrícola (operación 16.1.2), cofinanciada por la Unión Europea a través del fondo FEADER (90%) y la Junta de Andalucía (10%). Los autores también quieren agradecer la Beca de investigación predoctoral para el desarrollo del programa de I+D+i de la Universidad de Sevilla (IV.3 2017) y el contrato Torres-Quevedo (PTQ-17-09506) concedido a JMG.

Referencias

- Chen, S.W., Shivakumar, S.S., Dcunha, S., Das, J., Okon, E., Qu, C., Taylor, C.J., Kumar, V.; IEEE Robotics and Automation Letters; 2017; Vol 2, No. 2. 781-788

- Martínez, J., Egea, G., Agüera, J., & Pérez-Ruiz, M. A cost-effective canopy temperature measurement system for precision agriculture: a case study on sugar beet. Precision Agriculture, 2017; 18(1), 95110

- Yin, X., Lan, Y., Wen, S., Zhang, J., & Wu, S. Natural UAV tele-operation for agricultural application by using Kinect sensor. International Journal of Agricultural and Biological Engineering, 2018, 11(4), 173178.